2 連立一次方程式(反復法)

実用的なプログラムでは、非常に大きな連立方程式を計算しなくてはならない。数百万元 に及ぶことも珍しくない。これを、ガウス・ジョルダン法で 計算するの時間的にほとんど不可能である。そこで、これよりは格段に計算の速い方法が 用いられる。ここでは、その一つとして反復法を簡単に説明する。当然ここでも、連立方程式

を満たす

ここで、ある計算によりn回目で求められたものを

![]() とする。そして、計算回数を増やして、

とする。そして、計算回数を増やして、

| (2) |

になったとする。この様に計算回数を増やして、真の解に近づける方法を反復法という。

この様な方法は、行列

![]() を

を

![]() と分解するだけで、容易に作ることが

できる。たとえば、

と分解するだけで、容易に作ることが

できる。たとえば、

とすればよい。ここで、

2.1 ヤコビ法

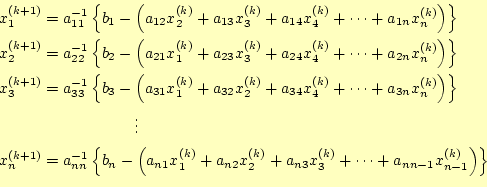

計数行列![$\displaystyle \left[ \begin{array}{@{ }ccccc@{ }} a_{11} & a_{12} & a_{13} & ...

... & \ddots & \vdots a_{n1} & a_{n2} & a_{n3} & \ldots & 0 \end{array} \right]$](img14.png) |

(4) |

と分解する。右辺第1項が行列

![$\displaystyle \boldsymbol{S}^{-1}= \left[ \begin{array}{@{ }ccccc@{ }} a_{11}...

...vdots & \ddots & \vdots 0 & 0 & 0 & \ldots & a_{nn}^{-1} \end{array} \right]$](img17.png) |

(5) |

と簡単である。k+1番目の近似解は、

とすると、k+1番目の解は

|

と計算できる。これが、ヤコビ法である。

2.2 ガウス・ザイデル法

ヤコビ法の特徴では、

そこで、

![]() の各成分の計算が終わると、それを直ちに使うことが考えば、

メモリーは半分で済む。即ち、

の各成分の計算が終わると、それを直ちに使うことが考えば、

メモリーは半分で済む。即ち、![]() を計算するときに、

を計算するときに、

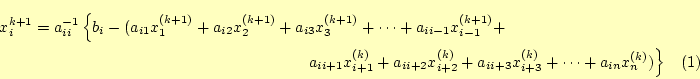

とするのである。実際の計算では、k+1番目の解は

と計算できる。これが、ガウス・ザイデル法である。

2.3 SOR法

ガウス・ザイデル法をもっと改善する方法がある。ガウス・ザイデル法の解の修正は、

具体的な計算手順は、次のようにする。ここでは、ガウス・ザイデル法の式

(8)を用いて、得られた近似解を

![]() としている。

としている。

これが、SOR法である。

ここで、問題なのが加速緩和係数![]() の値の選び方である。明らかに、それが1の場

合、ガウス・ザイデル法となりメリットは無い。また、1以下だと、ガウス・ザイデル法

よりも収束が遅い。ただし、ガウス・ザイデル法で収束しないような問題には使える。

の値の選び方である。明らかに、それが1の場

合、ガウス・ザイデル法となりメリットは無い。また、1以下だと、ガウス・ザイデル法

よりも収束が遅い。ただし、ガウス・ザイデル法で収束しないような問題には使える。

従って、1以上の値にしたいわけであるが、余り大きくすると、発散するのは目に見えて いる。これについては、2を越えると発散することが分かっている。最適値となると、だ いたい1.9くらいが選ばれることが多い。

ホームページ: Yamamoto's laboratory

著者: 山本昌志 Yamamoto Masashi

平成17年3月1日